通信世界网消息(CWW)近日,TechInsights发布的最新报告从市场、技术、采购、价格以及交货期五个方面展望了2025年AI市场发展。

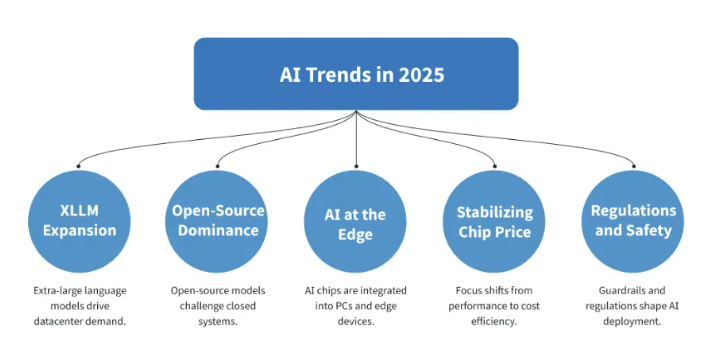

1、超大型语言模型(XLLMs)和超大型多模态模型(XLMMs)将涌现

大型语言模型(LLMs)或大型多模态模型(LMMs)的特征是拥有数十亿的参数。当前流行的模型拥有从十亿到数百亿个参数,并使用万亿级别的tokens进行训练。世界继续以惊人的速度产生数据,随着时间的推移,将使用数百万亿级别的tokens进行训练,这将进一步推动参数数量的增加,催生超大型语言模型(XLLMs)和超大型多模态模型(XLMMs)。

这种规模的增长将需要庞大的训练基础设施,并极大地推动数据中心AI芯片市场的发展。该行业距离AI模型规模的理论极限还有很远的路要走,TechInsights预计这种模型规模的增长趋势将在2025年继续。

2、大型语言模型(LLMs)的商品化将开始

当前的大型语言模型(LLMs)分为开源和闭源两种。闭源模型,如OpenAI的GPT-4和谷歌的Gemini,在推出时处于最先进水平,已成为企业构建AI应用的首选。然而,Meta最近发布的开源模型Llama 3.1在基准测试中的表现与闭源模型相当。因此,Llama已成为企业的热门首选模型,在流行的模型托管网站Hugging Face上的下载量增加了10倍。Llama 3.1在上下文长度和多语言支持方面突破了模型界限,并且Meta承诺长期支持开源。

目前,闭源模型的价格差异很大,基于模型大小,每百万个tokens的费用从几分钱到高达15美元不等。TechInsights预计,随着越来越多的企业开始基于开源模型开发应用,这一价格将显著下降。

3、AI将从AI PC开始走向边缘计算

迄今为止,大多数AI芯片活动都集中在数据中心市场,而PC则一直未能参与其中。然而,微软最近宣布的Copilot Plus,它大量依赖AI,已经提升了PC中专用AI芯片的需求。台式机和笔记本电脑处理器开始纳入神经处理单元(NPU),以提供良好的AI模型用户体验。TechInsights预计这一趋势将继续,未来几年,大多数PC都将配备NPU。

4、数据中心AI芯片价格将趋于稳定

过去五年间,AI加速器的平均销售价格(ASP)增长了四倍。目前生产的英伟达H100加速器在零售市场的价格高达4万美元,而两代前的V100价格仅为1万美元。半导体市场上这种价格上涨前所未有。构建最先进、最智能模型的行业竞赛一直是芯片过剩的主要驱动力。大部分硬件基础设施的资金来自英伟达的研发预算,以及成为竞赛第一名的渴望。训练一直是关键用例,性能是关键指标。芯片ASP一直是重要但次要的考虑因素。

5、监管和保障措施将变得突出

AI模型的一个关键挑战是它们容易产生幻觉,即生成无意义的输出。AI模型也无法可靠地区分信息的真伪。此外,这些模型还容易受到数据训练中的固有偏见的影响。随着这些模型越来越多地集成到生产环境中,任何非预期的结果都可能导致潜在的有害后果。

为了缓解这一问题,TechInsights预计软件供应商将更加注重为在生产应用中更安全地部署模型而实施保障措施。全球政府实体也将开始引入监管措施并施加某些限制,以缓解使用大型语言模型(LLM)可能引发的问题。虽然这不会破坏当前的AI热潮,但将对整体市场增长产生影响。