通信世界网消息(CWW)近日,TeleAI发布业内首个基于知识的视图万物布控大模型—Telesearch 2.0,打破模态间信息孤岛,可根据自然语言精准检索图片/视频,实现跨模态复杂语义精准理解、超万种目标精准检索。在自然语言的基础上,Telesearch 2.0支持上百个专业知识文档挂载,在理解复杂文档内容基础上,实现根据自然语言精准检索视觉,如根据全国几百部交通法规,搜索“机动车压线”,Telesearch 2.0能在理解复杂法规基础上进行逻辑推理,准确检索出存在“机动车压线”行为的视频。TeleAI用最前沿跨模态大模型检索技术,打破传统标签化检索壁垒,变革人们日常生活;勇担央企责任和使命,用AI技术,维护公共秩序,守护社会安全,赋能城市治理智能化升级,用科技驱动社会进步。

从标签、自然语言驱动视觉检索到基于复杂知识的视觉检索

开创视觉检索新格局

在信息爆炸的时代,如何高效、精确地从海量数据中检索出所需信息已成为亟待解决的难题。传统标签式检索已难以满足实际生活、工作中精准检索的需求,特别是在专业场景下许多任务往往更加复杂,已经远远超出了通常视觉任务的范畴,目标或事件都由专业术语、规则来定义,需要深厚的行业知识和逻辑推理能力。

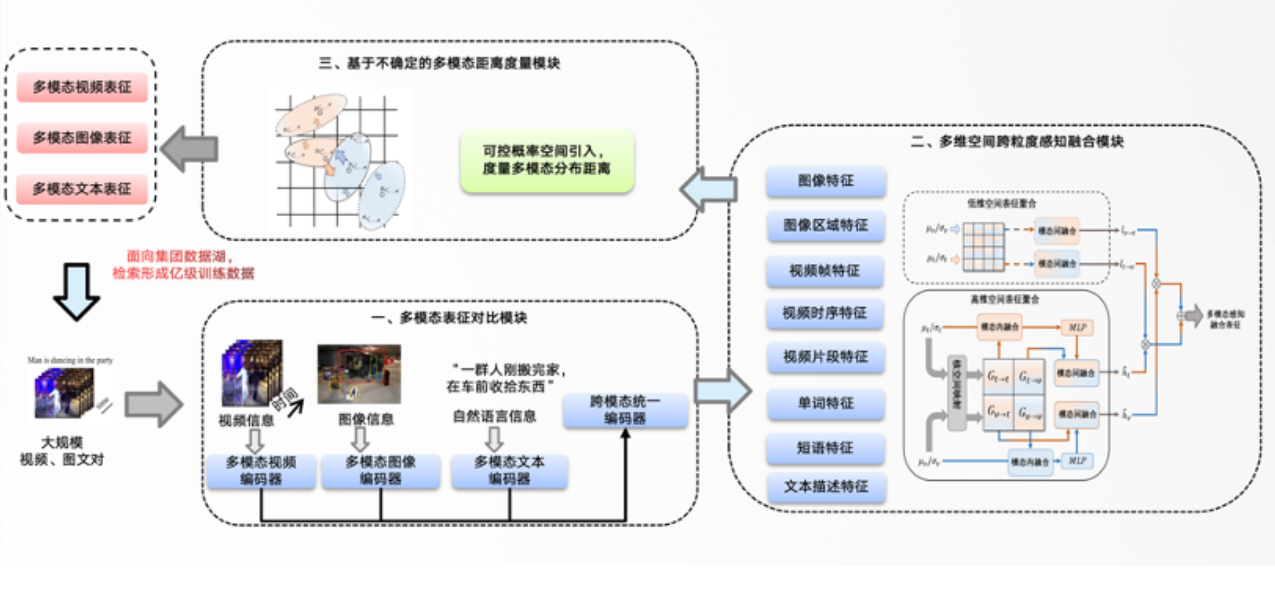

为了提升视觉大模型结合行业知识对复杂事件的理解和推理能力,TeleAI围绕知识可用和回答可信两个目标展开攻关,在细粒度多模态文档理解、视觉语言高效对齐、基于知识增强的长上下文感知理解技术上取得了突破,实现从根据标签检索、自然语言驱动的检索,到基于专业行业知识的检索的跨越,实现一键构建“行业专家”。

中国电信凭借在各行业深耕多年的优势和经验,积累了超亿级大规模训练数据及多模态标注数据,在中国电信集团 CTO、首席科学家、TeleAI院长李学龙教授带领下,坚持自主研发创新,结合视觉-语义模态各自特点与相互关系,创新性提出了基于多模态表征融合的检索架构,建立了大规模的多模态检索体系,统一表示视频、文本和图像等多种模态数据,检索精度达到业内领先,有效检索挖掘形成超亿级大规模训练数据。